Dipublikasikan: 21 Mei 2025

Policybazaar adalah salah satu platform asuransi terkemuka di India, dengan lebih dari 97 juta pelanggan terdaftar. Sekitar 80% pelanggan mengunjungi Policybazaar secara online setiap bulan, sehingga platform mereka harus menawarkan pengalaman pengguna yang lancar.

Tim di Policybazaar melihat bahwa sejumlah besar pengguna mengunjungi situs mereka pada malam hari, setelah jam kerja tim bantuan pelanggan. Agar pengguna tidak perlu menunggu hingga hari kerja berikutnya untuk mendapatkan jawaban atau mempekerjakan staf untuk bekerja semalaman, Policybazaar ingin menerapkan solusi untuk memberikan layanan langsung kepada pengguna tersebut.

Pelanggan memiliki banyak pertanyaan tentang paket asuransi, cara kerjanya, dan paket mana yang akan memenuhi kebutuhan mereka. Pertanyaan yang dipersonalisasi sulit ditangani dengan FAQ atau chatbot berbasis aturan. Untuk memenuhi kebutuhan ini, tim menerapkan bantuan yang dipersonalisasi dengan AI generatif.

73%

Pengguna meluncurkan dan terlibat dalam percakapan berkualitas

2 kali lipat

Rasio klik-tayang (CTR) lebih tinggi dibandingkan pesan ajakan sebelumnya

10x

Inferensi yang lebih cepat dengan WebGPU

Bantuan yang dipersonalisasi dengan Finova AI

Untuk memberikan jawaban yang dipersonalisasi dan bantuan pelanggan yang lebih baik dalam bahasa Inggris dan bahasa asli India beberapa pengguna, Policybazaar membuat chatbot asisten asuransi yang didukung teks dan suara yang disebut Finova AI.

Ada banyak langkah untuk mewujudkannya. Tonton panduan mendetail dalam presentasi kasus penggunaan dan strategi AI Web di dunia nyata dari Google I/O 2025.

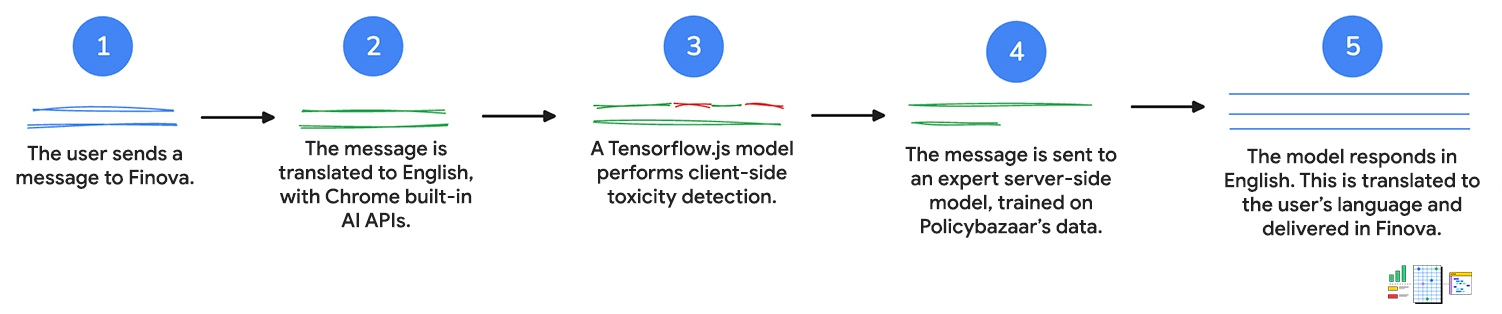

1. Input pengguna

Pertama, pelanggan mengirim pesan ke chatbot, baik dengan teks maupun suara. Jika pengguna berbicara kepada chatbot, Web Speech API akan digunakan untuk mengonversi suara menjadi teks.

2. Terjemahkan ke bahasa Indonesia

Pesan pelanggan dikirim ke Language Detector API. Jika API mendeteksi bahasa India, input akan dikirim ke Translator API untuk diterjemahkan ke bahasa Inggris.

Kedua API ini menjalankan inferensi sisi klien, yang berarti input pengguna tidak keluar dari perangkat selama terjemahan.

3. Pesan dinilai dengan deteksi toksisitas

Model deteksi toksisitas sisi klien digunakan untuk menilai apakah input pelanggan berisi kata-kata yang tidak pantas atau agresif. Jika ya, pelanggan akan diminta untuk menguraikan pesan. Pesan tidak akan dilanjutkan ke langkah berikutnya jika berisi bahasa beracun.

Hal ini membantu menjaga percakapan yang sopan bagi staf bantuan pelanggan untuk meninjau dan menindaklanjuti, jika diperlukan.

4. Permintaan dikirim ke server

Kueri yang diterjemahkan kemudian diteruskan ke model sisi server yang dilatih dengan data Policybazaar dan menampilkan respons dalam bahasa Inggris untuk pertanyaan tersebut.

Pelanggan bisa mendapatkan jawaban dan rekomendasi yang dipersonalisasi, serta jawaban atas pertanyaan yang lebih kompleks tentang produk.

5. Menerjemahkan ke bahasa pelanggan

Translator API, yang digunakan untuk menerjemahkan kueri awal, menerjemahkan kueri kembali ke bahasa pelanggan, seperti yang terdeteksi oleh Language Detector API. Sekali lagi, API ini berjalan di sisi klien, sehingga semua pekerjaan tersebut terjadi di perangkat mereka. Artinya, pelanggan dapat mendapatkan bantuan dalam bahasa utama mereka, sehingga bot chat dapat diakses oleh non-penutur bahasa Inggris.

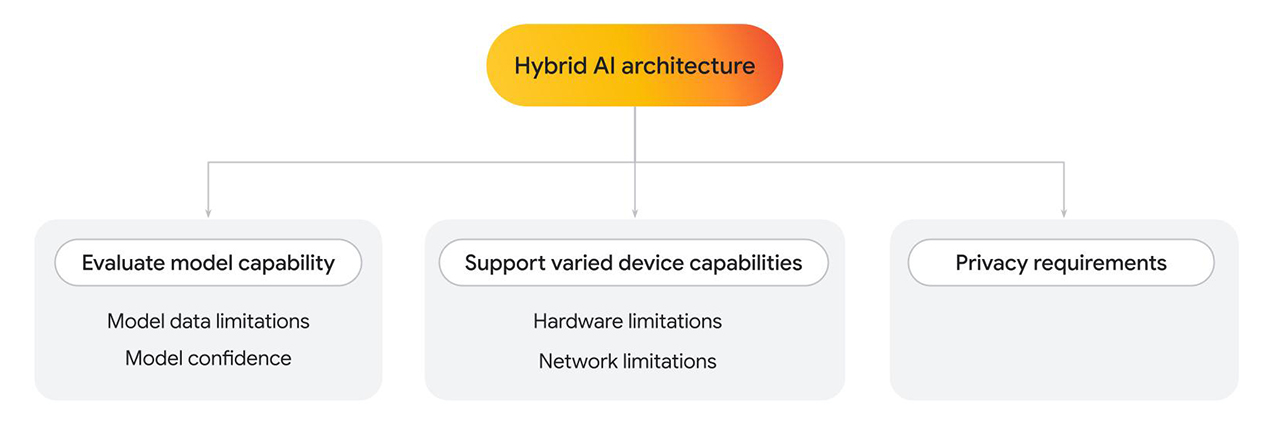

Arsitektur campuran

Finova AI, yang berjalan di platform desktop dan seluler, mengandalkan beberapa model untuk menghasilkan hasil akhir. Policybazaar membangun arsitektur campuran, dengan sebagian solusi berjalan di sisi klien dan sebagian berjalan di sisi server.

Ada beberapa alasan Anda mungkin ingin menerapkan arsitektur hybrid, baik Anda hanya menggunakan satu atau beberapa model.

- Evaluasi kemampuan model sisi klien. Kembali ke sisi server jika

diperlukan.

- Batasan data model: Model bahasa dapat bervariasi ukurannya secara signifikan, yang juga menentukan kemampuan tertentu. Misalnya, pertimbangkan situasi saat pengguna mengajukan pertanyaan pribadi terkait layanan yang Anda berikan. Model sisi klien mungkin dapat menjawab pertanyaan, jika dilatih di area tertentu tersebut. Namun, jika tidak dapat, Anda dapat kembali ke implementasi sisi server, yang dilatih pada set data yang lebih kompleks dan lebih besar.

- Keyakinan model: Dalam model klasifikasi, seperti moderasi konten atau deteksi penipuan, model sisi klien dapat menghasilkan skor keyakinan yang lebih rendah. Dalam hal ini, Anda mungkin ingin kembali ke model sisi server yang lebih canggih.

- Mendukung berbagai kemampuan perangkat.

- Batasan hardware: Idealnya, fitur AI dapat diakses oleh semua pengguna Anda. Pada kenyataannya, pengguna menggunakan berbagai perangkat, dan tidak semua perangkat dapat mendukung inferensi AI. Jika perangkat tidak dapat mendukung inferensi sisi klien, Anda dapat kembali ke server. Dengan pendekatan ini, Anda dapat membuat fitur Anda sangat mudah diakses, sekaligus meminimalkan biaya dan latensi jika memungkinkan.

- Batasan jaringan: Jika pengguna offline atau berada di jaringan yang tidak stabil, tetapi memiliki model yang di-cache di browser, Anda dapat menjalankan model sisi klien.

- Persyaratan privasi.

- Anda mungkin memiliki persyaratan privasi yang ketat untuk aplikasi Anda. Misalnya, jika bagian dari alur penggunaan memerlukan verifikasi identitas dengan informasi pribadi atau deteksi wajah, pilih model sisi klien untuk memproses data di perangkat dan mengirim output verifikasi (seperti lulus atau gagal) ke model sisi server untuk langkah berikutnya.

Untuk Policybazaar, yang memerlukan latensi rendah, efisiensi biaya, dan privasi, solusi sisi klien digunakan. Jika diperlukan model yang lebih kompleks yang dilatih pada data kustom, solusi sisi server akan digunakan.

Di sini, kita akan melihat lebih dekat implementasi model sisi klien.

Deteksi toksisitas sisi klien

Setelah pesan diterjemahkan, pesan pelanggan akan diteruskan ke model deteksi toksisitas TensorFlow.js, yang berjalan di sisi klien, di desktop dan seluler. Karena transkripsi akan diteruskan ke staf bantuan manusia untuk ditindaklanjuti, penting untuk menghindari bahasa yang tidak sopan. Pesan dianalisis di perangkat pengguna sebelum dikirim ke server, diikuti dengan staf bantuan manusia akhir.

Selain itu, analisis sisi klien memungkinkan penghapusan informasi sensitif. Privasi pengguna adalah prioritas utama, dan inferensi sisi klien membantu memungkinkannya.

Ada beberapa langkah yang diperlukan untuk setiap pesan. Dengan deteksi toksisitas, selain deteksi dan terjemahan bahasa, setiap pesan akan memerlukan beberapa perjalanan bolak-balik ke server. Dengan melakukan tugas ini di sisi klien, Policybazaar dapat secara signifikan membatasi perkiraan biaya fitur.

Policybazaar beralih dari WebGL ke backend WebGPU (untuk browser yang didukung), dan waktu inferensi meningkat 10 kali lipat. Pengguna menerima masukan yang lebih cepat untuk merevisi pesan mereka, yang menghasilkan interaksi dan kepuasan pelanggan yang lebih tinggi.

// Create an instance of the toxicity model.

const createToxicityModelInstance = async () => {

try {

//use WebGPU backend if available

if (navigator.gpu) {

await window.tf.setBackend('webgpu');

await window.tf.ready();

}

return await window.toxicity.load(0.9).then(model => {

return model;

}).catch(error => {

console.log(error);

return null;

});

} catch (er) {

console.error(er);

}

}

Engagement dan rasio klik-tayang yang tinggi

Dengan menggabungkan beberapa model dengan API web, Policybazaar berhasil memperluas bantuan pelanggan setelah jam buka. Hasil awal dari rilis terbatas fitur ini menunjukkan engagement pengguna yang tinggi.

73% pengguna yang membuka chatbot terlibat dalam percakapan multi-pertanyaan yang berlangsung beberapa menit, sehingga menghasilkan rasio pantulan yang rendah. Selain itu, program uji coba menunjukkan rasio klik-tayang 2 kali lebih tinggi untuk pesan ajakan bantuan pelanggan baru ini, yang menunjukkan interaksi pelanggan yang berhasil dengan Finova untuk pertanyaan mereka. Selain itu, beralih ke backend WebGPU untuk deteksi toksisitas sisi klien mempercepat inferensi hingga 10 kali lipat, sehingga menghasilkan masukan pengguna yang lebih cepat.

73%

Pengguna meluncurkan dan terlibat dalam percakapan berkualitas

2 kali lipat

Rasio klik-tayang (CTR) lebih tinggi dibandingkan pesan ajakan sebelumnya

10x

Inferensi yang lebih cepat dengan WebGPU

Resource

Jika Anda tertarik untuk memperluas kemampuan aplikasi web Anda sendiri dengan AI sisi klien:

- Pelajari cara menerapkan deteksi toksisitas sisi klien.

- Tinjau kumpulan demo AI sisi klien.

- Baca tentang Mediapipe dan Transformers.js. Anda dapat menggunakan model terlatih dan mengintegrasikannya dalam aplikasi dengan JavaScript.

- Kumpulan AI di Chrome untuk Developer

menyediakan referensi, praktik terbaik, dan info terbaru tentang teknologi yang mendukung

AI di Chrome dan lainnya.

- Ini termasuk studi kasus tentang cara Policybazaar dan JioHotstar menggunakan Translator dan Language Detector API untuk membuat pengalaman multibahasa.

- Pelajari contoh nyata untuk AI Web di I/O 2025.