게시일: 2025년 11월 10일

적절한 크기의 AI에 대해 읽어보면 작은 모델이 파운데이션 모델보다 지속 가능성이 높다는 것을 알 수 있습니다. 에너지를 적게 소비하고 사용자의 기기에서 실행할 수도 있어 지연 시간을 줄이고 더 나은 성능을 제공합니다.

의도적으로 사용 사례에 적합한 모델을 선택해야 합니다.

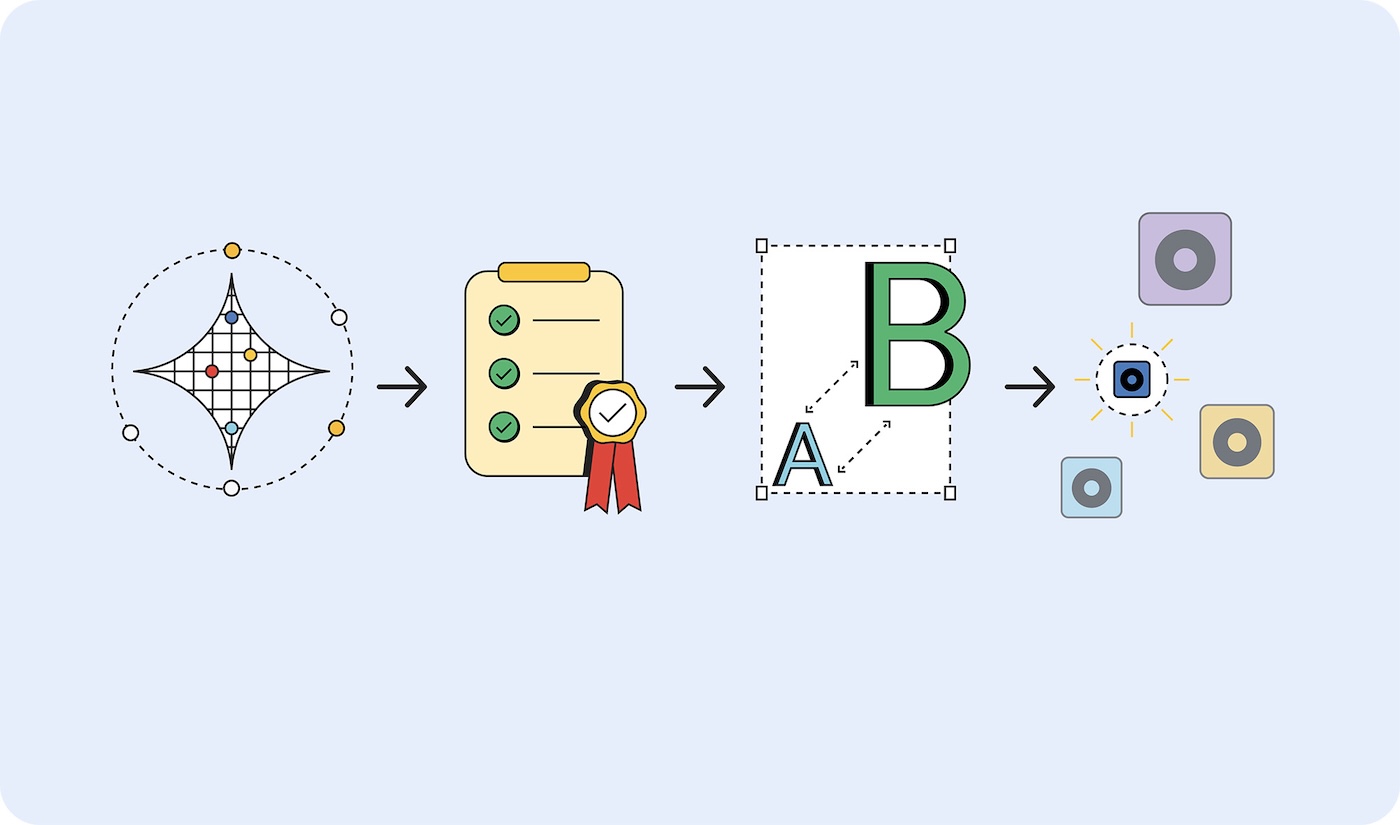

하지만 어떤 모델이 필요한지 어떻게 알 수 있을까요? 한 가지 방법은 애플리케이션의 성공 측정항목을 결정한 다음 파운데이션 모델로 프로토타입을 만드는 것입니다. 최근 뉴스에 나오는 파운데이션 모델은 대부분 대규모 언어 모델 (LLM)이지만, 파운데이션 모델에는 전문화되어 사용 사례에 더 적합할 수 있는 예측 AI도 포함됩니다.

성공 측정항목을 검증한 후 더 작은 모델로 배포하고 성공 기준을 충족하는 결과를 생성하는 가장 작은 모델을 찾을 때까지 테스트합니다.

대규모로 프로토타입을 제작하고 소규모로 배포

적절한 크기의 모델을 선택하려면 다음 단계를 따르세요.

- 작업이 가능한지 증명하세요. 가능한 가장 큰 모델을 사용하여 달성하려는 목표가 가능한지 테스트합니다. Gemini 2.5 Pro와 같은 대규모 언어 모델이나 다른 파운데이션 모델일 수 있습니다.

- 성공 기준 설정 입력 및 이상적인 출력 세트를 수집합니다. 예를 들어 번역 애플리케이션에는 영어로 된 문구 입력과 스페인어로 정확하게 번역된 해당 문구 출력이 있을 수 있습니다.

- 소규모에서 대규모로 테스트 더 작은 모델의 출력을 테스트 기준과 비교합니다. 가장 작은 모델부터 시작하여 점차 늘려 보세요. 프롬프트 엔지니어링을 사용하면 더 나은 결과를 얻을 수 있습니다. 더 큰 모델을 모집하여 출력을 비교하여 더 작은 모델에서 더 나은 결과를 생성할 수도 있습니다.

- 사용 사례에 허용되는 대답을 제공하는 가장 작은 모델을 선택합니다. 예를 들어 번역을 올바르게 출력하는 가장 작은 모델입니다.

모델이 호스팅되는 위치와 관계없이 온디바이스에 있을 만큼 작거나 서버에서 호스팅되어야 하는 경우 큰 모델보다 작은 모델을 사용하는 것이 더 효율적입니다.

모델 유형

처리하는 데이터에 따라 모델을 시각, 오디오, 텍스트로 분류했습니다. 예시 사용 사례와 사용 가능한 모델을 살펴보겠습니다.

시각적 처리

시각적 처리는 스틸 이미지 또는 동영상 평가일 수 있습니다.

이미지 분류: 접근성 규정 준수를 위한 대체 텍스트 생성부터 콘텐츠 검열을 통한 부적절한 이미지 필터링까지 다양한 용도로 사용하세요. 사람의 검토 없이 이미지의 내용을 파악해야 하는 경우 이 이미지 분류를 선택하세요.

모델 MobileNet, ResNeXt, ConvNeXt

객체 감지: 이미지 또는 동영상 스트림에서 특정 객체에 태그를 지정하고, 실제 객체에 반응하는 대화형 AR 환경을 만들거나, 항목을 식별하고 개수를 셀 수 있는 인벤토리 관리 시스템을 빌드합니다. 무생물의 사진이나 동영상이 있는 경우 객체 감지를 선택합니다.

모델 YOLOv8, DETR과 같은 객체 감지 모델

신체 자세 감지: 동작이나 신체 움직임으로 인터페이스를 제어하거나, 의류의 가상 착용 환경, 환자 움직임과 재활 진행 상황을 모니터링하는 원격 의료 플랫폼에 사용합니다. 사람의 신체 이미지나 동영상을 평가할 때는 신체 자세 감지를 선택하세요.

모델 MoveNet, BlazePose와 같은 포즈 추정 모델

얼굴 키포인트 감지: 안전한 얼굴 인증 시스템, 사용자 환경을 맞춤설정하는 감정 감지, 접근성 제어를 위한 시선 추적, 실시간 사진 필터 또는 미용 애플리케이션에 사용합니다. 사람의 얼굴 이미지나 동영상을 평가할 때 이 모델을 선택하세요.

모델 MediaPipe FaceMesh 및 OpenPose

손 자세 감지 모델: 사용자가 손 동작으로 탐색하는 터치 없는 인터페이스 컨트롤, 접근성을 위한 수화 번역 애플리케이션, 손 움직임에 반응하여 그림을 그리거나 디자인하는 창작 도구에 이러한 모델을 사용합니다. 또한 화면을 터치하기 어려운 환경(의료, 식품 서비스)이나 사용자가 컨트롤에서 멀리 떨어져 있는 경우(예: 발표자가 동작으로 슬라이드를 제어하는 프레젠테이션)에도 이러한 기능을 사용하는 것이 좋습니다.

모델 MediaPipe Hands와 같은 손 포즈 추정 모델

필기 인식: 필기 메모를 검색 가능한 디지털 텍스트로 변환하고, 메모 작성 애플리케이션의 스타일러스 입력을 처리하고, 사용자가 업로드한 양식이나 문서를 디지털화하는 데 사용됩니다.

모델 MiniCPM-o, H2OVL-Mississippi, Surya와 같은 광학 문자 인식 (OCR) 모델

이미지 세분화 모델: 일관된 이미지 배경이 중요하거나 이미지 수정이 필요한 경우 선택합니다. 예를 들어 정확한 배경 제거, 이미지 내에서 우려되는 특정 영역을 식별하는 고급 콘텐츠 스크리닝, 프로필 및 제품 사진과 같은 특정 요소를 분리하는 정교한 사진 편집 도구에 사용할 수 있습니다.

모델 Segment Anything (SAM), Mask R-CNN

이미지 생성: 라이선스 없이 필요에 따라 새 이미지를 만드는 데 사용됩니다. 이러한 모델을 사용하여 사용자 프로필의 맞춤 아바타, 전자상거래 카탈로그의 제품 이미지 변형, 마케팅 또는 콘텐츠 제작 워크플로의 맞춤 시각적 요소를 만들 수 있습니다.

모델: Nano Banana, Flux, Qwen Image와 같은 확산 모델

오디오 처리

오디오 파일의 오디오 처리 모델을 선택합니다.

오디오 분류: 사람의 검토 없이 오디오를 식별하고 설명해야 하는 경우에 사용합니다. 예를 들어 미디어 업로드에서 배경 음악, 환경 소리 또는 음성 콘텐츠를 실시간으로 식별하고, 오디오 라이브러리의 콘텐츠를 자동으로 태그하고, 소리 기반 사용자 인터페이스 컨트롤을 사용할 수 있습니다.

모델 Wav2Vec2 및 AudioMAE

오디오 생성: 라이선스 없이 주문형 오디오 콘텐츠를 만듭니다. 예를 들어 대화형 웹 환경을 위한 맞춤 사운드 효과를 만들거나, 사용자 환경설정 또는 콘텐츠에서 배경 음악을 생성하거나, 알림음이나 인터페이스 피드백과 같은 오디오 브랜딩 요소를 생성하는 데 사용할 수 있습니다.

모델 다양한 전문 오디오 생성 모델이 있습니다. 이러한 요구사항은 매우 구체적이므로 모델을 나열하지 않겠습니다.

텍스트 음성 변환 (TTS): 접근성 규정 준수를 위해 작성된 콘텐츠를 일관되고 자연스러운 음성으로 변환하고, 교육 콘텐츠 또는 튜토리얼을 위한 음성 해설을 만들고, 사용자가 선호하는 언어로 텍스트를 말하는 다국어 인터페이스를 빌드합니다.

모델 Orpheus 및 Sesame CSM

Speech-to-text (STT): 라이브 이벤트 또는 회의의 실시간 스크립트 작성, 음성 제어 탐색 및 검색 기능, 동영상 콘텐츠 접근성을 위한 자동 자막 등 사람 음성의 녹음 파일을 스크립트 작성합니다.

모델 Whisper Web Turbo, NVIDIA Canary, Kyutai

텍스트 처리

자연어 분류 (NLP): 대량의 텍스트, 태그 시스템, 조정 시스템을 자동으로 정렬하고 라우팅하는 데 사용합니다. 텍스트는 사용자 메시지나 지원 티켓일 수 있으며, 고객 피드백이나 소셜 미디어 멘션에서 감정을 감지하고 다른 사용자에게 도달하기 전에 스팸이나 부적절한 콘텐츠를 필터링할 수 있습니다.

모델 BERT, DistilBERT, RoBERTa

대화형 AI: 채팅 인터페이스와 대화형 시스템을 빌드합니다. 고객 지원 챗봇, 개인 AI 어시스턴트, 유사한 대화형 상호작용은 LLM의 가장 좋은 사용 사례 중 일부입니다. 다행히도 기기에 적합할 만큼 작고 학습 및 프롬프트에 훨씬 적은 에너지가 필요한 언어 모델이 있습니다.

모델 Gemma 2 27B, Llama 3.1, Qwen2.5

번역 모델 애플리케이션에서 여러 언어를 지원하는 데 사용합니다. 로컬 언어 모델은 실시간 언어 번역을 처리하고, 글로벌 플랫폼을 위해 여러 언어로 된 사용자 생성 콘텐츠를 변환하며, 민감한 콘텐츠를 사용자의 기기에 보관하는 비공개 문서 번역을 지원할 수 있습니다.

모델 Gemma Nano, Granite 1.5B, GSmolLM3, Qwen 3.4B와 같은 SLM

영양 성분표 읽기

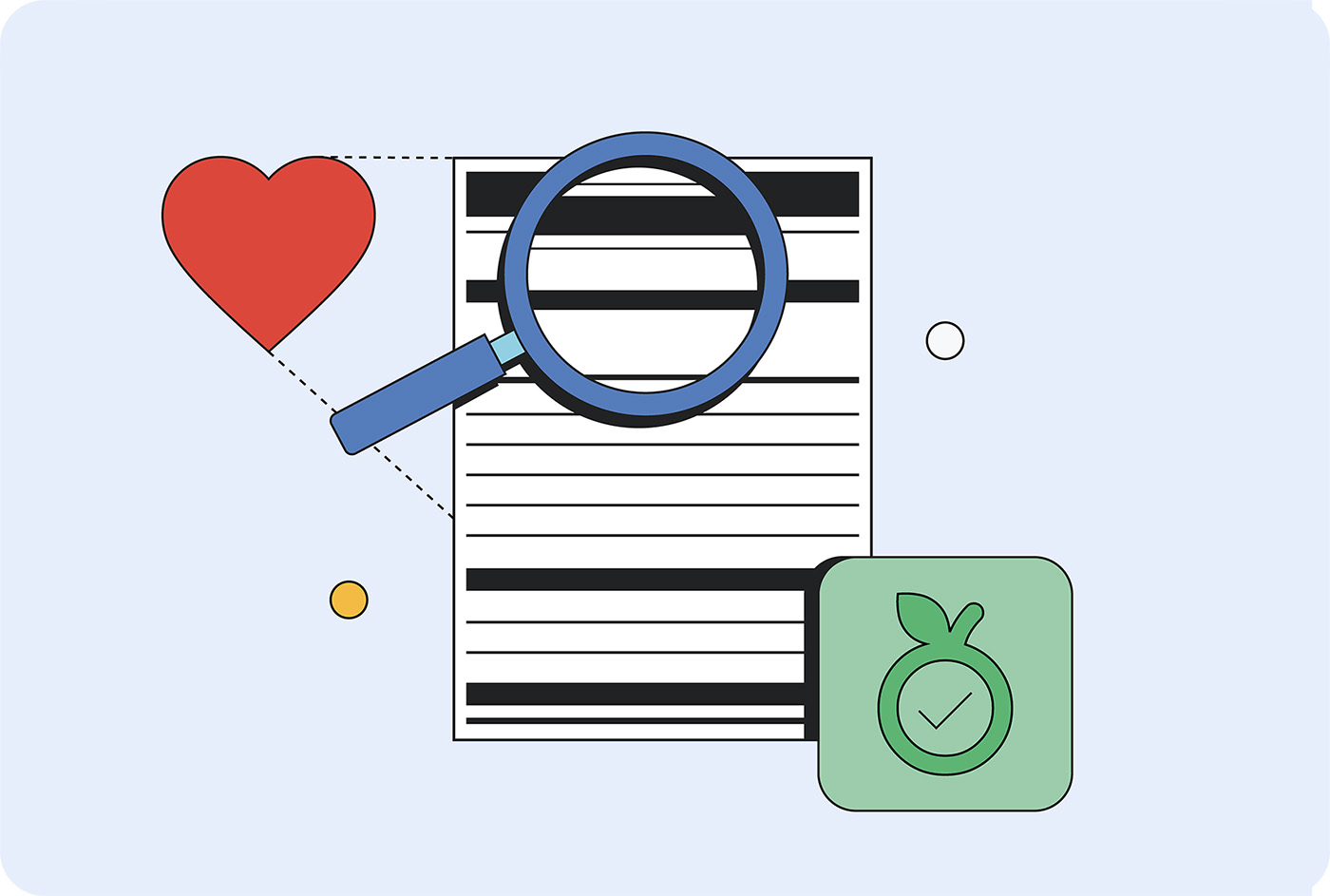

모델마다 다른 위치의 다른 하드웨어에서 실행될 때 소비하는 리소스 양이 다릅니다. 아직 벤치마킹할 측정 표준은 없지만 이 정보를 AI '영양 라벨'에 표시하려는 움직임이 있습니다.

2018년 Google의 Margaret Mitchell과 동료들이 도입한 모델 카드는 모델의 사용 목적, 제한사항, 윤리적 고려사항, 성능을 보고하는 표준화된 접근 방식입니다. 오늘날 많은 기업(예: Hugging Face, Meta, Microsoft)이 모델 카드 형식을 사용하고 있습니다.

수명 주기, 책임, 거버넌스, 규정 준수를 다루는 IBM의 AI Factsheets는 엔터프라이즈 환경에서 더 인기가 있습니다. EU 인공지능법, NIST AI 위험 관리 프레임워크, ISO 42001과 같은 규제 프레임워크에서는 이 문서를 요구합니다.

Google은 업계 전반의 추론 비용 투명성을 촉구했습니다. 이러한 수치는 모델 카드와 팩트 시트에 추가될 수 있습니다. Hugging Face는 모델 카드에 탄소 비용을 추가했으며 AI 에너지 점수 이니셔티브를 통해 에너지 효율 측정의 표준화를 위해 노력했습니다.

적절한 규모의 AI 옹호

적절한 규모의 AI는 고객과 비즈니스 모두에게 지속 가능하고 실용적인 선택입니다.

회사가 채택한 호스팅 모델이 기준 학습 및 추론 리소스 요구사항을 공개하도록 요구하여 업계를 발전시킬 수 있습니다. 충분한 수의 고객이 투명성을 요구하면 제공업체가 이러한 세부정보를 공개할 가능성이 높아집니다.