Suas decisões de design moldam diretamente a responsabilidade e a segurança do seu sistema de IA. Por exemplo, você decide como selecionar fontes de dados, configurar o comportamento do modelo ou apresentar saídas de IA aos usuários. Essas escolhas têm consequências no mundo real para seus usuários e sua empresa.

Neste módulo, abordamos três dimensões essenciais da governança de IA:

- Privacidade: trate os dados com responsabilidade, explique o que é coletado e minimize o que sai do navegador.

- Justiça: verifique se há comportamento discriminatório (tendência) nos seus modelos e crie loops que permitam aos usuários sinalizar problemas.

- Confiança e transparência: crie um sistema transparente e com confiança calibrada para que os usuários continuem se beneficiando dele, apesar da incerteza e de possíveis erros.

Para cada tema, explicamos como ele se manifesta em diferentes produtos de IA. Em seguida, vamos analisar as três camadas da sua solução de IA: dados, inteligência e experiência do usuário. Você vai aprender o que observar, como resolver problemas e como manter uma governança eficaz e leve.

Privacidade

Você aprendeu que os dados reais de uso e interação são o núcleo de qualquer sistema de IA. Os dados impulsionam o aprendizado, a avaliação e a melhoria contínua. Boas práticas de privacidade permitem manter esses dados seguros e dar aos usuários controle sobre as informações deles.

As expectativas de privacidade variam muito dependendo do produto e do público. Em produtos de consumo, as expectativas geralmente envolvem a proteção das informações de identificação pessoal (PII) dos indivíduos, como nomes, mensagens e comportamento de navegação. Em ambientes empresariais, o foco muda para a soberania, a confidencialidade e a proteção da propriedade intelectual dos dados.

Setores que afetam a subsistência ou o bem-estar das pessoas, como saúde, finanças e educação, exigem proteções de privacidade mais rigorosas do que áreas de menor risco, como entretenimento.

Vamos ver como a privacidade pode ser gerenciada nos diferentes componentes do seu sistema de IA.

Dados

Para melhorar continuamente seu sistema de IA, colete dados sobre as interações dos usuários, incluindo entradas, saídas, feedback e erros. Essas informações podem ser reutilizadas para avaliação, ajuste fino do modelo ou exemplos de poucos disparos em comandos. Ela também pode fundamentar seu design de UX.

Confira algumas diretrizes para coleta de dados responsável:

- Colete apenas o que é necessário para o aprendizado. Uma pesquisa de produtos com tecnologia de IA não precisa do perfil completo de um usuário para melhorar os resultados. Na maioria dos casos, basta fornecer a consulta, os padrões de cliques e os dados de sessão anônimos.

- Remover informações sensíveis. Remova todas as PII (informações de identificação pessoal) antes de enviar dados para modelos externos. É possível fazer isso com anonimização, pseudonimização ou agregação.

- Limitar a retenção. Exclua os registros e os dados em cache assim que eles cumprirem a finalidade. Ciclos de retenção curtos reduzem o risco sem bloquear insights.

Documente quais informações você coleta, por quanto tempo as mantém e por que elas são necessárias. Se você não conseguir explicar claramente seus fluxos de dados para um usuário não técnico, eles provavelmente serão muito complexos para controlar ou justificar.

Inteligência

Ao interagir com seu sistema de IA, os usuários podem inserir informações particulares ou sensíveis sem saber ou por descuido. Esse risco é especialmente alto em interfaces de chat ou escrita abertas, em que não é possível restringir o que os usuários digitam.

Embora seja possível impedir o envio de determinadas palavras, essas informações podem ser sensíveis ao contexto. Se o modelo for executado em um servidor gerenciado por um provedor externo, ele poderá reutilizar a entrada do usuário como dados de treinamento. Com o tempo, o modelo pode revelar fragmentos de texto particular, credenciais ou outros detalhes confidenciais para outros usuários.

Veja como se proteger contra violações de privacidade durante a inferência:

Analise as APIs de terceiros com cuidado. Você precisa saber exatamente o que acontece com os dados enviados. As entradas são registradas, retidas ou reutilizadas para treinamento? Evite serviços opacos e prefira provedores com políticas e controles transparentes.

Se você treinar ou ajustar modelos por conta própria, abstraia detalhes sensíveis nos dados de treinamento. Cuidado com o aprendizado de atalhos. Por exemplo, em uma solicitação de pontuação de crédito, os CEPs podem levar o modelo a fazer suposições sobre raça ou status socioeconômico. Isso pode resultar em previsões injustas e reforçar desigualdades existentes.

Em domínios sensíveis, prefira a inferência do lado do cliente. Isso pode ser feito com IA integrada, um modelo no navegador ou um modelo personalizado do lado do cliente. Você vai saber mais sobre essa escolha no próximo módulo, Escolher uma plataforma.

Experiência do usuário

A interface do aplicativo oferece uma chance de mostrar aos usuários o que está acontecendo, conquistar a confiança deles e dar controle sobre os dados:

- Seja transparente. Rótulos curtos na sua interface, como "Processado localmente" ou "Enviado com segurança para análise", podem ajudar a criar confiança. Considere adicionar divulgação progressiva para mais detalhes, como dicas que explicam quando a análise acontece no dispositivo ou em um servidor.

- Pergunte no contexto. Peça consentimento quando for relevante. "Você gostaria de compartilhar pesquisas anteriores para melhorar as recomendações?" é muito mais significativo do que uma ativação geral.

- Ofereça controles simples. Adicione alternâncias claramente visíveis para personalização, recursos baseados na nuvem ou compartilhamento de dados.

- Dar visibilidade. Inclua um pequeno painel de privacidade para que os usuários possam gerenciar os dados sem sair do app.

- Explique por que você coleta dados. Os usuários podem estar mais abertos a compartilhar dados se entenderem como eles serão usados. O mesmo vale para suas políticas de retenção e gerenciamento.

A privacidade na IA da Web não é uma única etapa de compliance, mas uma mentalidade de design contínua:

- Dados: colete menos e proteja mais.

- Inteligência:reduza a memorização de dados potencialmente sensíveis por modelos externos.

- UX:torne a privacidade transparente e controlável para os usuários.

Imparcialidade

Os sistemas de IA podem ter vieses que levam a discriminação injusta. Isso é especialmente verdadeiro em áreas como contratação, direito e finanças, em que o viés pode distorcer decisões importantes que afetam diretamente pessoas reais.

Por exemplo, um modelo de contratação treinado com dados históricos de recrutamento pode associar determinados recursos demográficos a uma qualidade inferior de candidatos, penalizando sem intenção candidatos de grupos sub-representados, em vez de avaliar habilidades e experiência relevantes para o trabalho.

Dados

Seus dados de treinamento são um conjunto de informações isoladas que podem refletir vieses do mundo real e até mesmo introduzir novos. Confira as etapas práticas para tornar o viés relacionado a dados transparente e gerenciável:

- Documente suas fontes de dados e cobertura. Publique uma declaração curta para ajudar os usuários a entender onde o modelo pode falhar. Por exemplo, "Este modelo foi treinado principalmente com conteúdo em inglês, com representação limitada de texto técnico".

- Execute verificações de diagnóstico. Use testes A/B para revelar diferenças sistemáticas. Por exemplo, compare como seu sistema lida com "Ela é uma ótima líder", "Ele é um ótimo líder" e "Elu é uma ótima líder". Pequenas discrepâncias no sentimento ou no tom podem indicar um viés mais profundo.

- Rotule seus conjuntos de dados. Adicione metadados leves, como domínio, região e nível de formalidade, para facilitar auditorias, filtragens e rebalanceamentos futuros.

Se você estiver treinando ou ajustando modelos personalizados, equilibre seus conjuntos de dados. Uma representação mais ampla reduz o viés de forma mais eficaz do que corrigir a tendência depois que o modelo é criado.

Inteligência

Na camada de inteligência, o viés se transforma em comportamento aprendido. É possível adicionar salvaguardas, lógica de reclassificação ou regras híbridas para direcionar as saídas para a justiça e a inclusão:

- Teste regularmente para identificar vieses. Use filtros de detecção de viés para sinalizar frases problemáticas, como termos de gênero ou tom excludente. Monitore a deriva ao longo do tempo.

- Para modelos preditivos, tenha cuidado com dados sensíveis. Atributos como CEP, escolaridade ou renda podem codificar indiretamente características sensíveis, como raça ou classe.

- Gerar e comparar várias saídas. Classifique os resultados com base na neutralidade, diversidade e tom antes de determinar qual saída compartilhar com o usuário.

- Adicione regras para aplicar restrições de justiça. Por exemplo, bloqueando respostas que reforçam estereótipos ou não representam exemplos diversos.

Experiência do usuário

Na interface do usuário, seja transparente sobre o raciocínio do modelo e incentive o feedback:

- Forneça argumentos para as saídas da IA. Por exemplo, "Recomendado para um tom profissional com base nas suas entradas anteriores*." Isso ajuda os usuários a entender que o sistema segue uma lógica definida, não um julgamento oculto.

- Dê aos usuários um controle significativo. Permita que eles ajustem o comportamento do modelo usando configurações ou comandos. Por exemplo, escolha preferências de tom, complexidade ou estilo visual.

- Facilitar a denúncia de viés ou imprecisão. Quanto mais fácil for sinalizar um problema, mais dados do mundo real você vai receber para melhorar seu sistema de IA.

- Feche o ciclo de feedback. Não deixe que os relatórios dos usuários desapareçam. Envie esses dados de volta para seu retreinamento ou lógica de regras e compartilhe o progresso de forma visível: "Atualizamos nossa moderação para reduzir o viés cultural nas recomendações".

O viés nasce nos dados, é amplificado pelos modelos e aparece na experiência do usuário. É possível resolver esse problema em todos os três níveis do seu sistema de IA:

- Dados:torne as fontes de dados transparentes e equilibradas.

- Inteligência:detecte, teste e mitigue vieses nas saídas.

- UX:capacitar os usuários a identificar e corrigir o viés com controle e feedback.

Confiança e transparência

A confiança determina se as pessoas usam, adotam e recomendam seu produto.

A maioria dos usuários espera aplicativos previsíveis. Por exemplo, os cliques em botões sempre realizam a ação indicada e levam ao mesmo lugar. A IA quebra essa expectativa porque o comportamento dela é altamente variável e muitas vezes imprevisível. Além disso, os sistemas de IA têm um potencial inerente de falha: os modelos de linguagem alucinam fatos, os modelos preditivos rotulam dados incorretamente e os agentes se tornam desonestos.

Seus usuários são a última linha de defesa contra esses erros.

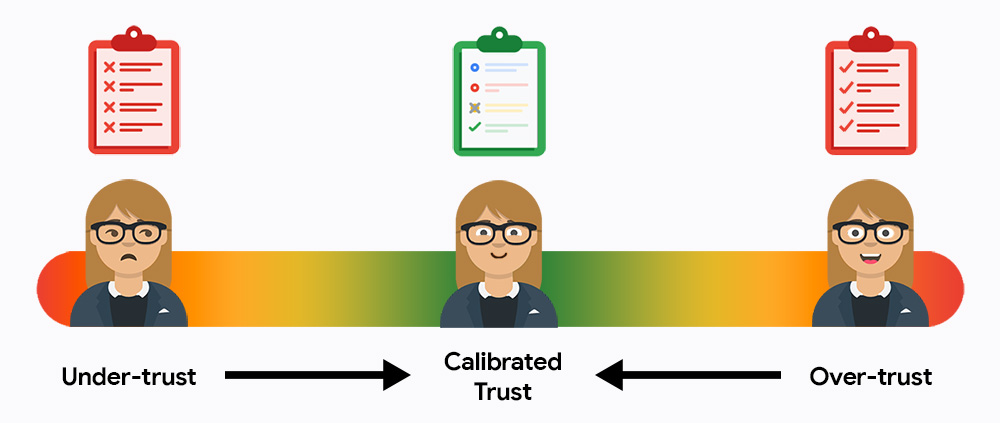

No início, os usuários provavelmente confiam pouco ou demais no seu sistema. A falta de confiança significa que eles não vão usar o sistema, e a confiança excessiva significa que eles aceitam completamente as saídas, sem verificar se há erros. Sua tarefa é levar os usuários ao meio-termo da confiança calibrada, em que eles dependem da IA para ter eficiência, mas ainda assumem a responsabilidade pelos resultados finais.

Dados

Na camada de dados, a confiança é criada explicando claramente a cobertura e a origem dos seus dados:

- Seja explícito sobre a origem e a linhagem dos dados.

- Documentar a atualização e a inatividade dos dados.

- Descrever os tipos de conteúdo que o modelo já viu e onde ele pode ter dificuldades, como dados em idiomas diferentes do inglês.

À medida que seu sistema de IA acumula interações e feedback ao longo do tempo, considere manter snapshots versionados dos dados para explicar como as saídas evoluíram.

Inteligência

Na camada de inteligência, é possível gerenciar a confiança usando explicabilidade, indicadores de confiança e design modular:

- Forneça explicações contextuais e just-in-time. De acordo com o paradoxo do usuário ativo, é melhor incorporar microexplicações no contexto, diretamente nas interações, para que os usuários entendam o que o sistema de IA está fazendo enquanto o usam.

- Comunique limitações e modos de falha antecipadamente. Informe aos usuários onde a IA pode ter dificuldades. Por exemplo, "Evite humor ou jargão do domínio para ter resultados melhores". As dicas curtas e contextuais oferecem transparência sem interromper o fluxo.

- Indicadores de confiança e lógica de fallback mantêm a confiabilidade da IA em situações de incerteza. É possível estimar a confiança com base em proxies, como pontuações de probabilidade ou taxas de sucesso anteriores. Defina substituições seguras para saídas claramente incorretas.

- As arquiteturas modulares tornam a IA mais transparente. Por exemplo, se um assistente de escrita processar gramática, estilo e tom em etapas separadas, indique o que mudou em cada etapa: "Tom: menos formal; complexidade: simplificada".

Experiência do usuário

A experiência do usuário oferece um vasto campo de jogo para criar e calibrar a confiança. Confira algumas técnicas e padrões para testar:

- Adaptar conteúdo educativo. Não suponha que seus usuários entendem de IA. Ofereça orientações leves para usuários avançados e explicações detalhadas para iniciantes.

- Aplique a divulgação progressiva. Comece com pequenas dicas. Inclua um texto que informe que você usou IA, como "Isso foi gerado automaticamente", e permita que os usuários cliquem para mais informações.

- Feche os ciclos de feedback com resultados visíveis. Quando os usuários avaliam, corrigem ou substituem uma sugestão de IA, compartilhe como a entrada deles molda o comportamento futuro: "Você preferiu respostas concisas. Ajustei o tom de acordo com a solicitação." A visibilidade transforma o feedback em confiança.

- Lide com erros de maneira adequada. Quando o sistema comete um erro ou dá um resultado de baixa confiança, reconheça isso e delegue uma revisão ao usuário. Por exemplo, "Esta sugestão pode não corresponder à sua intenção. Revise antes de publicar." Ofereça um caminho claro para o usuário tentar de novo, editar ou reverter para um fallback seguro.

Em resumo, para lidar com a incerteza e o potencial de erro inerente da IA, oriente os usuários da dúvida ou da confiança excessiva para uma calibragem adequada da confiança:

- Dados: seja transparente sobre a origem dos dados.

- Inteligência: torne o raciocínio modular e explicável.

- UX: design para clareza e feedback progressivos.

Seus pontos principais

Neste módulo, abordamos três pilares principais da IA responsável: privacidade, imparcialidade e confiança. Isso pode parecer complicado, principalmente quando você está começando ou tentando passar do protótipo para a produção.

Concentre seus esforços nas áreas mais críticas e defina sua própria abordagem para a governança de IA. A iteração é fundamental. Cada lançamento e rodada de feedback do usuário vai aumentar sua compreensão de onde o sistema precisa de mais proteções, transparência ou flexibilidade.

Recursos

Confira alguns recursos mais avançados sobre os temas abordados neste módulo:

- A comparação de privacidade e segurança do Google Assistente com tecnologia de IA oferece uma análise detalhada das políticas de privacidade de IA.

- Um artigo sobre memorização de LLM, um modo de falha de privacidade crítico em que um modelo retém e pode ser solicitado a reproduzir informações específicas e sensíveis dos dados de treinamento.

- Analise os recursos diretamente associados ao modelo escolhido. Por exemplo, o Google Cloud oferece recursos de segurança.

- O kit de ferramentas de IA responsável oferece recursos para desenvolvedores sobre todos os tópicos abordados neste módulo.

Recursos

Confira alguns recursos mais avançados sobre os temas abordados neste módulo:

- A comparação de privacidade e segurança do Google Assistente com tecnologia de IA oferece uma análise detalhada das políticas de privacidade de IA.

- Um artigo sobre memorização de LLM, um modo de falha de privacidade crítico em que um modelo retém e pode ser solicitado a reproduzir informações específicas e sensíveis dos dados de treinamento.

- Analise os recursos diretamente associados ao modelo escolhido. Por exemplo, o Google Cloud oferece recursos de segurança.

- O Responsible AI Toolkit (link em inglês) oferece recursos para desenvolvedores sobre todos os temas abordados neste módulo.

Teste seu conhecimento

Qual é uma prática de privacidade recomendada em relação à coleta de dados para IA?

O que é confiança calibrada?

Para garantir a imparcialidade na camada "Inteligência", qual ação os desenvolvedores podem tomar?

Qual é uma técnica de UX para gerar confiança e transparência?