Predykcyjna AI wyodrębnia statystyki z istniejących danych, a generatywna AI idzie o krok dalej i tworzy coś nowego. Może pisać tekst, generować obrazy, tworzyć kod, a nawet projektować pełne interfejsy użytkownika. Oto kilka typowych przykładów zastosowań generatywnej AI:

- Tworzenie treści: asystenci AI do pomocy w pisaniu mogą tworzyć wersje robocze i ulepszać istniejący tekst.

- Podsumowywanie: narzędzia takie jak przeglądy od Google AI skracają długie dokumenty, spotkania lub strony internetowe do zwięzłych, przydatnych podsumowań.

- Generowanie kodu: narzędzia dla programistów wykorzystują generatywną AI do pisania i refaktoryzacji kodu, co zwiększa wydajność programistów.

- Tworzenie obrazów i komponentów: za pomocą modeli wizyjnych użytkownicy mogą tworzyć komponenty wizualne, takie jak banery i miniatury.

Pętla generatywnej AI

Większość modeli generatywnej AI jest trenowana przy użyciu sieci neuronowych i architektur transformerów. Modele uczą się sugerować następny element w sekwencji, np. kolejne słowo, piksel lub nutę, na podstawie poprzednich elementów.

Z matematycznego punktu widzenia nie różni się to zbytnio od predykcyjnej AI. Oba rodzaje modeli uczą się wzorców na podstawie danych. Różnica polega na skali.

W przypadku predykcyjnej AI opcje wyjściowe są ograniczone do kilku etykiet, np. „rezygnacja” lub „brak rezygnacji”. W przypadku generatywnej AI przestrzeń wyjściowa może obejmować setki tysięcy opcji. Mechanizm prognozowania, który został wytrenowany na miliardach przykładów, przekształca się w zaawansowany silnik zdolny do generowania nowych, nieznanych wyników.

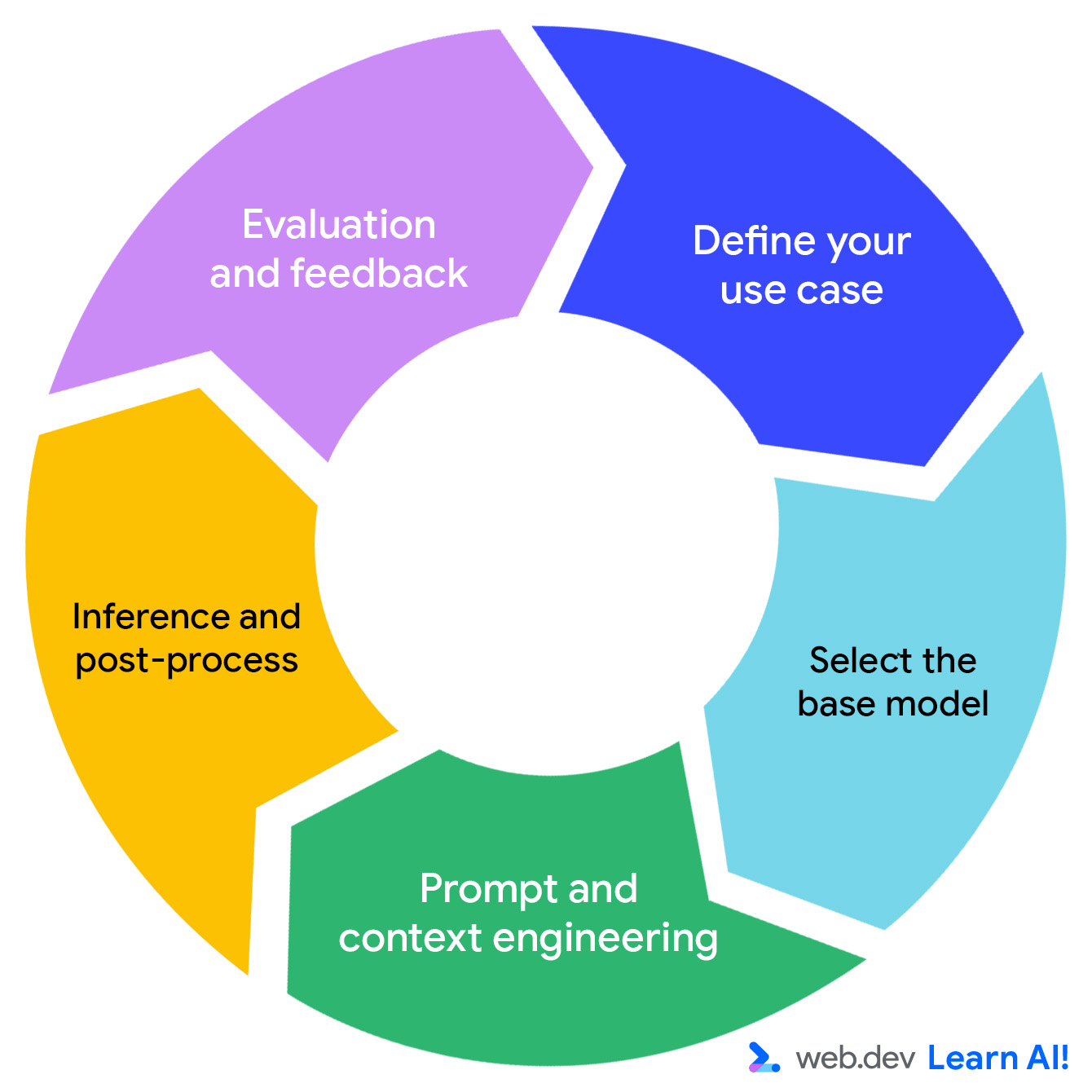

Opracowywanie systemu generatywnej AI odbywa się w sposób iteracyjny.

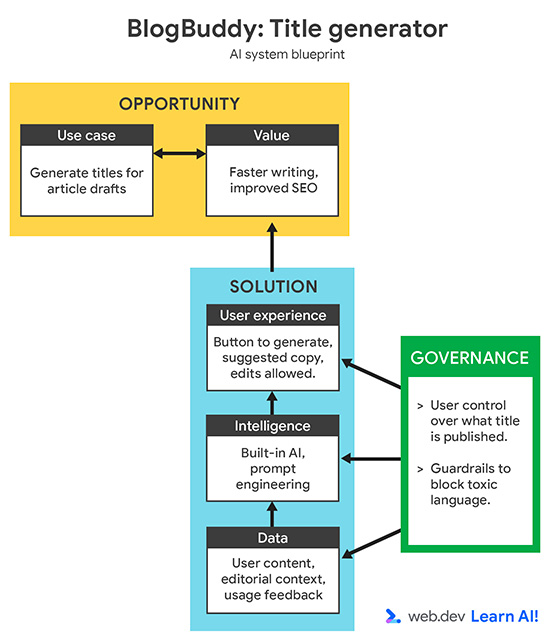

Wyjaśnimy, jak to działa, na przykładzie naszej przykładowej aplikacji BlogBuddy, czyli asystenta systemu zarządzania treścią, który pomaga użytkownikom generować chwytliwe opisy i tytuły artykułów zoptymalizowane pod kątem SEO.

Określ swój przypadek użycia

Opis problemu powinien zawierać:

- Rodzaj danych wejściowych i wyjściowych Mogą to być tekst (proza lub kod), obrazy lub dźwięk.

- Metoda wprowadzania. Czy treść pochodzi z pola przesyłania, pola tekstowego lub innych danych wejściowych?

- Odbiorcy Kto wykonuje to zadanie? Czy mają ogólną wiedzę, czy potrzebują specjalistycznej wiedzy?

Funkcje BlogBuddy są związane z generowaniem tekstu. Dane wejściowe są częściowo ustrukturyzowane: użytkownicy podają temat lub krótki szkic, a model zwraca różne wersje. Odbiorcami są osoby zajmujące się marketingiem, które mają specjalistyczną wiedzę z zakresu redakcji.

Ważne jest, aby ustalić standard jakości wyników. W naszym przypadku chcemy wygenerować krótki, łatwy do przejrzenia tekst zawierający wiele słów kluczowych, który będzie pasować do stylu publikacji.

Jasne wyznaczniki sukcesu pomogą Ci pokierować dalszymi działaniami. Więcej informacji o zbieraniu danych o skuteczności znajdziesz w artykule Tworzenie oprogramowania na podstawie oceny.

Wybierz model podstawowy

Dostępnych jest wiele modeli wstępnie wytrenowanych na dużych, uniwersalnych zbiorach danych. Ich działanie można dostosować do konkretnych potrzeb. Modele generatywnej AI są zwykle znacznie większe i bardziej złożone niż modele predykcyjne, dlatego lepiej jest budować na podstawie istniejącego modelu niż tworzyć i trenować własny.

Twój wybór określa możliwości produktu, jego koszt, możliwość dostosowania i granice prywatności. Wybór modelu jest ściśle powiązany z platformą, na której wdrażasz system AI.

W dalszej części tego kursu dowiesz się, jak wybrać platformę.

Tworzenie promptów i kontekstu

Po wybraniu modelu musisz podać mu odpowiednie instrukcje za pomocą prompta. W przypadku BlogBuddy możemy przesłać modelowi taki prompt:

Generate three short, engaging title suggestions for this article

Do promptu możesz dodać wiele rodzajów informacji. Przykład:

- Prompt systemowy, który określa ogólne zachowanie.

- Kontekst specyficzny dla danych wejściowych bieżącego zadania.

- instrukcje dla użytkowników w aplikacjach konwersacyjnych, takich jak chatboty czy agenci;

Wnioskowanie i przetwarzanie końcowe

Po złożeniu prompta jest on wysyłany do modelu w celu wygenerowania odpowiedzi. Możesz zmieniać parametry modelu, w tym temperaturę (wpływającą na kreatywność) i maksymalną liczbę tokenów (wpływającą na długość i szczegółowość), aby dostosować sposób działania modelu. Po wygenerowaniu dane wyjściowe są często przetwarzane zgodnie z dodatkowymi regułami i zabezpieczeniami.

Możesz na przykład przeformułować tekst, który zawiera określenia związane z płcią, złagodzić ton wypowiedzi lub odfiltrować zakazane słowa.

Aby zwiększyć przejrzystość i zaufanie, możesz dodać mniejszy, pomocniczy model, który będzie klasyfikować lub podsumowywać wynik. Na przykład: „Wprowadzenie wygenerowane na podstawie 12 powiązanych artykułów. Ufność: wysoka.

Pętla oceny i informacji zwrotnych

Przestrzeń wyjściowa generatywnej AI jest praktycznie nieskończona, więc większość promptów nie ma jednej prawidłowej odpowiedzi. Standardowe testy porównawcze, takie jak MMLU czy SQuAD, mogą mierzyć ogólne możliwości modelu, ale rzadko odzwierciedlają konkretne potrzeby użytkowników. W kontekście produktu musisz określić własny zestaw wskaźników jakościowych i ilościowych:

- Dokładność: czy dane wyjściowe są zgodne z prawdą?

- Przydatność: czy dane wyjściowe spełniają oczekiwania określone w prompcie lub intencje użytkownika?

- Czytelność i ton: czy dane wyjściowe są jasne i zgodne ze standardami marki?

- Wkład człowieka: ile ręcznej edycji lub selekcji jest wymagane?

- Zrozumienie domeny: czy odpowiedź odzwierciedla wiedzę z określonej dziedziny?

Aby ocenić te dane, możesz połączyć weryfikację przez weryfikatora z automatycznym ocenianiem. Możesz na przykład poprosić użytkowników o ocenę wyników w rzeczywistych sytuacjach, użyć drugiego modelu do automatycznej oceny (zwanego też LLM-as-a-judge) i przeprowadzać okresowe wewnętrzne weryfikacje pod kątem uprzedzeń lub halucynacji.

Podczas tworzenia za pomocą technologii generatywnej jednym z Twoich największych atutów są rzeczywiste dane o użytkowaniu. Jeśli to możliwe, rejestruj te interakcje, aby dostosowywać prompty i konteksty, testować różne modele lub z czasem modyfikować parametry. Każda interakcja użytkownika, poprawka lub ocena staje się informacją zwrotną, która może pomóc Ci określić kolejne kroki optymalizacji:

- Nieoczekiwane dane wejściowe użytkownika mogą pomóc Ci określić, czy rozwiązujesz właściwy problem.

- Powtarzające się żądania dotyczące konkretnej domeny mogą wpływać na wybór modelu. Możesz przełączyć się z dużego, ogólnego modelu LLM na mały, dostrojony model.

- Częste halucynacje mogą wskazywać na brak konkretnego kontekstu w promptach.

- Duże zmiany mogą wskazywać na niewystarczający kontekst udostępniony. Model nie ma świadomości informacji, które użytkownik uważa za oczywiste.

Z czasem te pętle opinii przekształcają funkcję generatywnej AI ze statycznego wywołania modelu w żywy system, który stale dostosowuje się do potrzeb i preferencji użytkowników.

Typowe problemy i sposoby ich rozwiązywania

Generatywna AI działa w otwartej przestrzeni danych wejściowych i wyjściowych, więc zakres ryzyka jest znacznie szerszy niż w przypadku systemów predykcyjnych. Oprócz generowania nieprawidłowych wyników może tworzyć toksyczne, stronnicze lub wprowadzające w błąd treści, a nawet nieumyślnie manipulować użytkownikami. Takie błędy mogą podważyć zaufanie klientów i narazić Twoją firmę na konsekwencje finansowe lub prawne.

Dlatego generatywna AI wymaga proaktywnego i ciągłego podejścia do zarządzania ryzykiem. Oto niektóre z najczęstszych zagrożeń:

- Halucynacje: model zmyśla fakty lub podaje nieprawdziwe szczegóły. Aby temu zapobiec, używaj RAG do weryfikacji faktów.

- Nadmierne zaufanie: użytkownicy zakładają, że wyniki są zawsze prawidłowe. Aby temu zapobiec, zachęcaj do sprawdzania i edytowania treści zamiast do automatycznego publikowania. W artykule Zarządzanie AI: odpowiedzialne tworzenie dowiesz się, jak pomóc użytkownikom w określaniu poziomu zaufania.

- Niespójność: wyniki bardzo się różnią w zależności od uruchomienia. Aby temu zapobiec, używaj szablonów promptów, kontroli temperatury lub przykładów z małą liczbą prób, aby ustabilizować ton i strukturę.

- Toksyczne lub szkodliwe treści: model generuje teksty zawierające uprzedzenia, obraźliwe lub manipulacyjne treści. Aby temu zapobiec, przed wyświetleniem zastosuj filtry moderacji i klasyfikatory toksyczności. Stale testuj wyniki za pomocą rzeczywistych promptów i utrzymuj pętlę opinii, aby oznaczać przypadki brzegowe i ponownie trenować model.

- Opóźnienia i koszty: duże modele mogą działać wolno i być kosztowne. Szczególnie w przypadku wdrożeń na dużą skalę trudno jest z góry oszacować koszt i wykorzystanie zasobów przez modele. Aby temu zapobiec, używaj buforowania, przetwarzania wsadowego i mniejszych modeli do krótkich zadań.

Wnioski

Krótko mówiąc, generatywna AI przekształca surowe pomysły w konkretne treści, takie jak teksty, obrazy, kod czy rozmowy. Sprawdza się tam, gdzie kreatywność i zdolność adaptacji mają większe znaczenie niż precyzja.

Jako deweloper stron internetowych możesz osiągnąć sukces, projektując odpowiednie prompty, opierając model na właściwych danych i stale dostosowując system do preferencji użytkowników.

Zasoby

Dowiedz się więcej o wybieraniu mniejszych i bardziej ekologicznych modeli. Aby dowiedzieć się więcej:

- Weź udział w szybkim szkoleniu z uczenia maszynowego w kontekście generatywnej AI.

- Zapoznaj się z zestawem narzędzi odpowiedzialnej generatywnej AI.

- Więcej informacji o różnych typach modeli podstawowych w generatywnej AI znajdziesz w rozdziale 5 The Art of AI Product Development (Sztuka tworzenia produktów AI).

Sprawdź swoją wiedzę

Jaka jest podstawowa różnica między wynikami generatywnej AI a wynikami predykcyjnej AI?

Jaką rolę odgrywa temperatura modelu?

Dlaczego standardowe testy porównawcze często nie wystarczają do oceny generatywnej AI?

Które z tych działań może pomóc w ograniczeniu halucynacji?

Co należy zrobić z opiniami użytkowników zgodnie z pętlą generatywnej AI?